En un mundo cada vez más impulsado por la inteligencia artificial, uno de los retos más significativos es no solo entrenar modelos de aprendizaje automático, sino también implementarlos de manera eficiente en entornos de producción. En este contexto, BentoML surge como una solución destacada. Este framework de código abierto está diseñado para simplificar las operaciones de aprendizaje automático, conocidas como MLOps, facilitando la implementación, escalabilidad y gestión de modelos de IA en diversos entornos.

BentoML se ha ganado la aceptación entre ingenieros de datos y desarrolladores de inteligencia artificial debido a su capacidad para construir sistemas de inferencia optimizados que son compatibles con múltiples modelos. A esto se suma su integración con herramientas avanzadas para mejorar el rendimiento y la observabilidad.

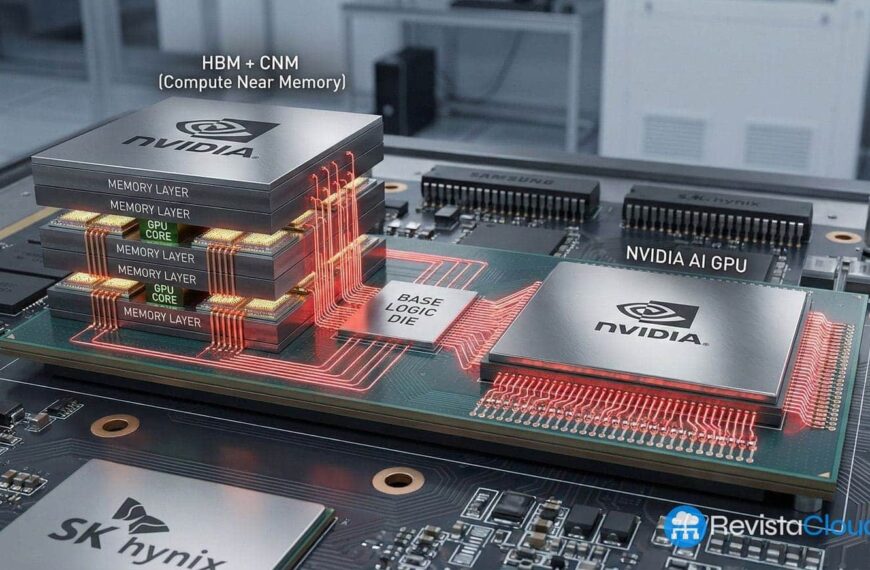

Entre las características más notables de BentoML se encuentran su soporte para cualquier modelo de IA/ML, lo que facilita la implementación de modelos de frameworks populares como TensorFlow, PyTorch y Scikit-learn. Además, BentoML optimiza el rendimiento mediante técnicas como dynamic batching y ejecución distribuida. La creación de APIs es sencilla, ya que permite convertir scripts de inferencia en servidores REST API con solo unas pocas líneas de código. Asimismo, su integración automática con Docker genera imágenes con todas las dependencias necesarias, asegurando despliegues reproducibles. También es compatible con CPU y GPU, maximizando la utilización de los recursos.

BentoML no se limita a la provisión de modelos. Forma parte de un ecosistema amplio que incluye BentoCloud, una plataforma en la nube para gestionar despliegues a gran escala, y otras herramientas como OpenLLM y BentoDiffusion, enfocadas en modelos de lenguaje y generación de imágenes y video respectivamente.

Un ejemplo práctico de la versatilidad de BentoML es la implementación de un servicio de conversión de texto a voz (TTS) con el modelo Bark de Hugging Face, desplegado en BentoCloud. Con una sencilla configuración del entorno e implementación en la nube, el servicio es capaz de transformar texto en audio. Además, BentoCloud ofrece avanzadas herramientas de monitoreo para medir el rendimiento en tiempo real.

Cuando se compara BentoML con otras soluciones, destaca por su facilidad de uso, configuración automática y escalabilidad integrada. Esto lo convierte en una opción atractiva para científicos de datos que no poseen experiencia en DevOps, al ofrecer una mayor simplicidad y efectividad frente a opciones como Kubernetes, Docker o TensorFlow Serving.

En conclusión, BentoML es una plataforma versátil y eficiente que habilita a los desarrolladores para desplegar y escalar modelos de IA de forma ágil y sencilla. Su integración con herramientas de IA, enfoque en la optimización del rendimiento y facilidad de uso la convierten en una solución ideal para tanto iniciados como expertos en MLOps. Para más detalles, la documentación oficial y ejemplos prácticos están disponibles en su repositorio de GitHub.