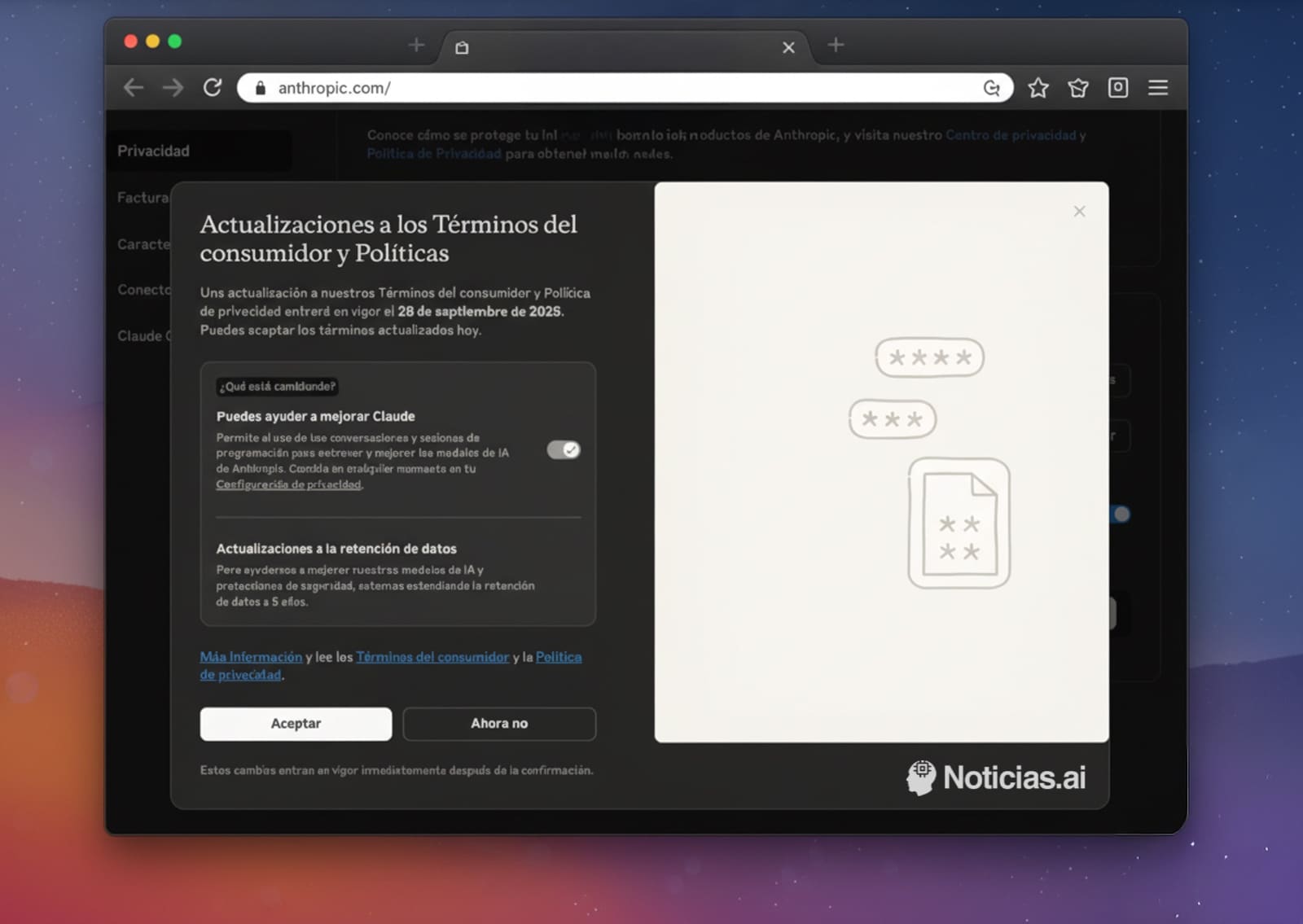

La reciente decisión de Anthropic, la empresa detrás de Claude AI, ha encendido nuevamente el debate sobre la privacidad de los datos de los usuarios en la era digital. La compañía ha anunciado que, a partir del 28 de septiembre de 2025, las interacciones con su inteligencia artificial se utilizarán automáticamente para entrenar sus modelos, a menos que los usuarios desactiven esta opción de manera voluntaria.

Este cambio en las políticas de privacidad ha generado controversia, ya que Anthropic se había destacado anteriormente por no utilizar las interacciones de sus usuarios como material de entrenamiento, diferenciándose de gigantes como OpenAI o Google. Sin embargo, la empresa defiende esta nueva estrategia argumentando que busca fortalecer las defensas contra abusos y mejorar la seguridad de sus modelos.

El proceso para que los usuarios excluyan sus datos es sencillo pero no muy visible. Aquellos que no lo hagan verán sus datos retenidos durante un período de hasta cinco años, despertando críticas por parte de especialistas en privacidad digital que consideran este lapso inusualmente extenso.

Esta política afecta a los planes individuales de Claude, mientras que los servicios empresariales y bajo contrato, así como las integraciones API, quedan exentos. La decisión ha sido comparada con movimientos similares de otras empresas tecnológicas que han introducido funciones de IA generativa bajo un sistema de exclusión voluntaria que muchos consideran insuficiente.

En el contexto regulatorio actual, donde la Unión Europea y EE.UU. están prestando más atención al uso de datos por parte de las tecnológicas, este tipo de cambios podría enfrentarse a desafíos legales. Expertos en derecho digital alertan sobre el riesgo que representa almacenar información personal durante largos períodos, pese a que Anthropic alega que no vende datos a terceros y que los filtra para proteger la privacidad.

Mientras algunas empresas, como el navegador Vivaldi, eligen no integrar funciones de IA generativa citando preocupaciones sobre la privacidad, otras como Anthropic monetizan la información del usuario. Este contraste alimenta un debate en curso sobre el equilibrio entre innovación y la salvaguarda de la privacidad digital.

El uso de datos para entrenar IA plantea un dilema: si bien puede impulsar el desarrollo tecnológico, también compromete la privacidad de quienes generan esos datos. Así, la evolución de la inteligencia artificial seguirá asediada por la tensión entre la necesidad de datos y la protección de los derechos individuales.