En los últimos años, la adopción de agentes de inteligencia artificial (IA) generativa por parte de organizaciones del sector salud y ciencias de la vida ha transformado el descubrimiento de fármacos, los dispositivos médicos y la atención al paciente. Sin embargo, la transición tecnológica en estas industrias altamente reguladas no está exenta de desafíos normativos. La implementación de estos sistemas debe cumplir rigurosamente con las normativas de Buenas Prácticas (GxP), que incluyen Buenas Prácticas Clínicas (GCP), Buenas Prácticas de Laboratorio (GLP) y Buenas Prácticas de Fabricación (GMP).

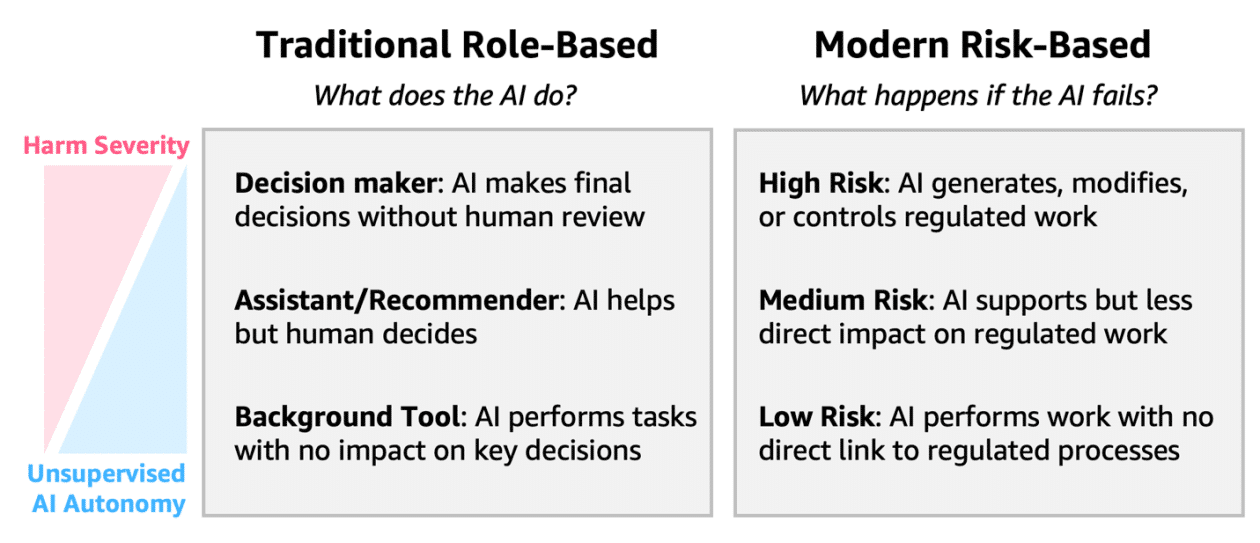

La creación de agentes de IA en entornos GxP requiere un enfoque detallado basado en perfiles de riesgo. A diferencia de la validación simplificada, la inteligencia generativa presenta desafíos de explicabilidad, resultados probabilísticos y aprendizaje continuo. Esta complejidad demanda evaluaciones de riesgo minuciosas, lo que a menudo complica la implementación, incrementa costos y ralentiza la innovación, perjudicando la calidad del producto y la atención al paciente.

El entorno regulador se adapta y evoluciona para enfrentar estos retos. Las metodologías tradicionales de Validación de Sistemas Informáticos (CSV) están siendo complementadas por nuevas estrategias de Aseguramiento de Software Informático (CSA), que priorizan métodos de validación basados en riesgos específicos y el impacto real de cada sistema. Esto aporta un enfoque más ágil y adaptado a las particularidades de cada herramienta de IA.

La implementación efectiva de sistemas de IA en entornos GxP no solo se basa en características tecnológicas, sino también en el contexto operativo. Las guías de la FDA sugieren clasificar los riesgos considerando la gravedad del daño potencial, la probabilidad de ocurrencia y la detectabilidad de fallos. Un marco de implementación basado en riesgos permite equilibrar innovación y cumplimiento regulatorio, ajustando los esfuerzos de validación según niveles de riesgo, en vez de aplicar medidas uniformes indiscriminadamente.

En este contexto, AWS emerge como un aliado esencial para la conformidad regulatoria, ofreciendo infraestructura y servicios que permiten a las organizaciones mantener un enfoque organizado y coherente en el cumplimiento. Esto incluye la gestión documentada de usuarios y roles, optimizando el acceso y mantenimiento de registros.

La correcta implementación de agentes de IA en entornos GxP requiere una clara comprensión del modelo de responsabilidad compartida entre los clientes y AWS. Mientras AWS se responsabiliza de la protección de su infraestructura, las organizaciones deben garantizar que sus soluciones sean eficaces y cumplan con la normativa.

Es crucial establecer criterios de aceptación y protocolos de validación que correspondan al uso previsto de los sistemas de IA. A medida que las organizaciones de salud adoptan estos agentes, deben considerar tanto el riesgo como el contexto operativo, asegurándose de que cumplen con los estándares de GxP sin sacrificar la innovación.