DeepSeek AI, una prometedora startup en el ámbito de la inteligencia artificial, ha irrumpido en el mercado con el lanzamiento de su más reciente modelo de lenguaje, DeepSeek-R1. Este modelo de última generación promete revolucionar el mundo del procesamiento de datos gracias a su innovador proceso de entrenamiento en múltiples etapas, que incluye un método de aprendizaje por refuerzo. A diferencia de otros modelos convencionales que se rigen únicamente por pre-entrenamiento y ajuste fino, DeepSeek-R1 se distingue por integrar un enfoque de cadena de pensamiento (CoT), que facilita la descomposición de consultas complejas en pasos lógicos, mejorando así la claridad y precisión de las respuestas generadas.

DeepSeek-R1 no solo destaca por su sofisticación teórica, sino también por su eficiencia técnica. Al utilizar las construcciones de ejecución paralela de subprocesos de NVIDIA, el modelo optimiza significativamente el proceso de entrenamiento. Su marco combina con habilidad el ajuste fino supervisado (SFT) y la optimización de política robusta en grupos (GRPO), garantizando resultados que son tanto transparentes como interpretables.

Dentro del portafolio de modelos de DeepSeek AI, varias variantes han captado la atención. Entre ellas, DeepSeek-V3, que emplea una arquitectura de Mezcla de Expertos (MoE), permite la activación selectiva de subredes específicas por cada entrada. Esto no solo mejora la eficiencia energética, sino que también supera las limitaciones de las redes neuronales tradicionales. En contraste, DeepSeek-R1-Zero, otra variación basada en DeepSeek-V3, enfrenta retos en términos de legibilidad y mezcla de lenguajes, a pesar de su avance en el uso del aprendizaje por refuerzo.

El modelo DeepSeek-R1, una evolución directa de DeepSeek-V3, ha sido meticulosamente diseñado para un entrenamiento más avanzado, incorporando datos de SFT a través del innovador método de muestreo por rechazo. Con un ciclo adicional de aprendizaje reforzado, este modelo ha emergido como una herramienta robusta y de alto rendimiento.

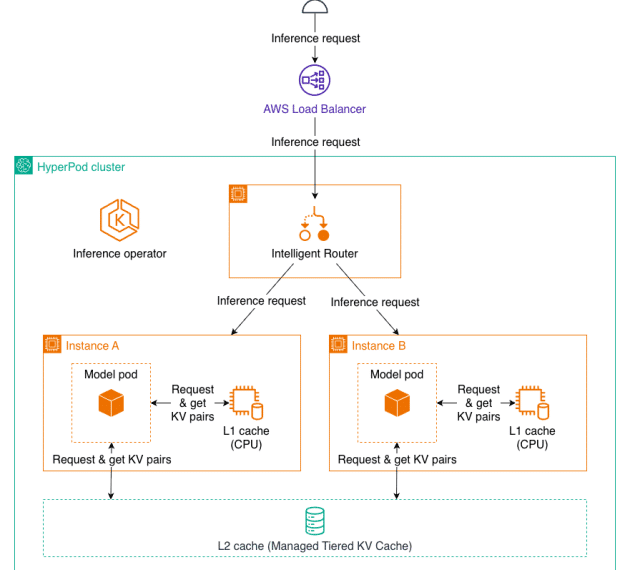

En un desarrollo paralelo, se ha dado a conocer la optimización del alojamiento de modelos DeepSeek-R1 destilados mediante el uso de Hugging Face Text Generation Inference (TGI) en Amazon SageMaker AI. Este framework está específicamente diseñado para afrontar los exigentes requerimientos de latencia y computación de modelos avanzados de lenguaje. SageMaker AI facilita el despliegue de estos modelos optimizados, proporcionando una integración eficiente con la pila de inferencia de Hugging Face para asegurar un despliegue escalable y costo-efectivo.

Las ventajas de TGI son notables, incluyendo la paralelización de tensores, el batching continuo, la cuantización, la decodificación especulativa y el streaming de tokens en tiempo real, lo que incrementa de manera significativa la eficiencia en la generación de texto a gran escala. Amazon SageMaker AI ofrece un despliegue sin complicaciones de los modelos DeepSeek-R1, con funcionalidades avanzadas de autoscalado y balanceo de carga automático, optimizando así el uso de recursos y disminuyendo costos durante períodos de baja demanda. Esta flexibilidad también contempla la posibilidad de un alojamiento privado mediante cargas en un bucket de S3.

Cada variante de DeepSeek-R1 ha sido rigurosamente evaluada en función de su desempeño en inferencia, utilizando métricas críticas que aseguran la escalabilidad y efectividad para su aplicación en escenarios reales. La aparición de DeepSeek AI con estos modelos innovadores promete marcar un antes y un después en el ámbito del procesamiento lingüístico y la inteligencia artificial.