En el marco de la creciente necesidad de eficiencia y personalización en la inferencia de inteligencia artificial (IA), Meta ha anunciado un avance significativo en su línea de aceleradores personalizados, los MTIA (Meta Training and Inference Accelerator). En un esfuerzo por reducir la dependencia de las populares arquitecturas GPU, la compañía ha presentado cuatro nuevas generaciones de estos chips, que estarán en producción o listos para su despliegue entre 2026 y 2027.

Este movimiento de Meta resalta una tendencia emergente entre los gigantes de la tecnología conocidos como hiperescalares. La diversificación de las arquitecturas de silicio está tomando protagonismo, desafiando la supremacía de Nvidia, líder en la provisión de GPUs para entrenamiento de modelos de inteligencia artificial. No obstante, esta transición no sugiere una ruptura total, sino una segmentación estratégica: mientras las GPUs de Nvidia continuarán siendo cruciales para entrenamientos complejos, Meta y sus competidores están optando por chips propios para procesos de inferencia, donde se prioriza la eficiencia energética y los costos operativos.

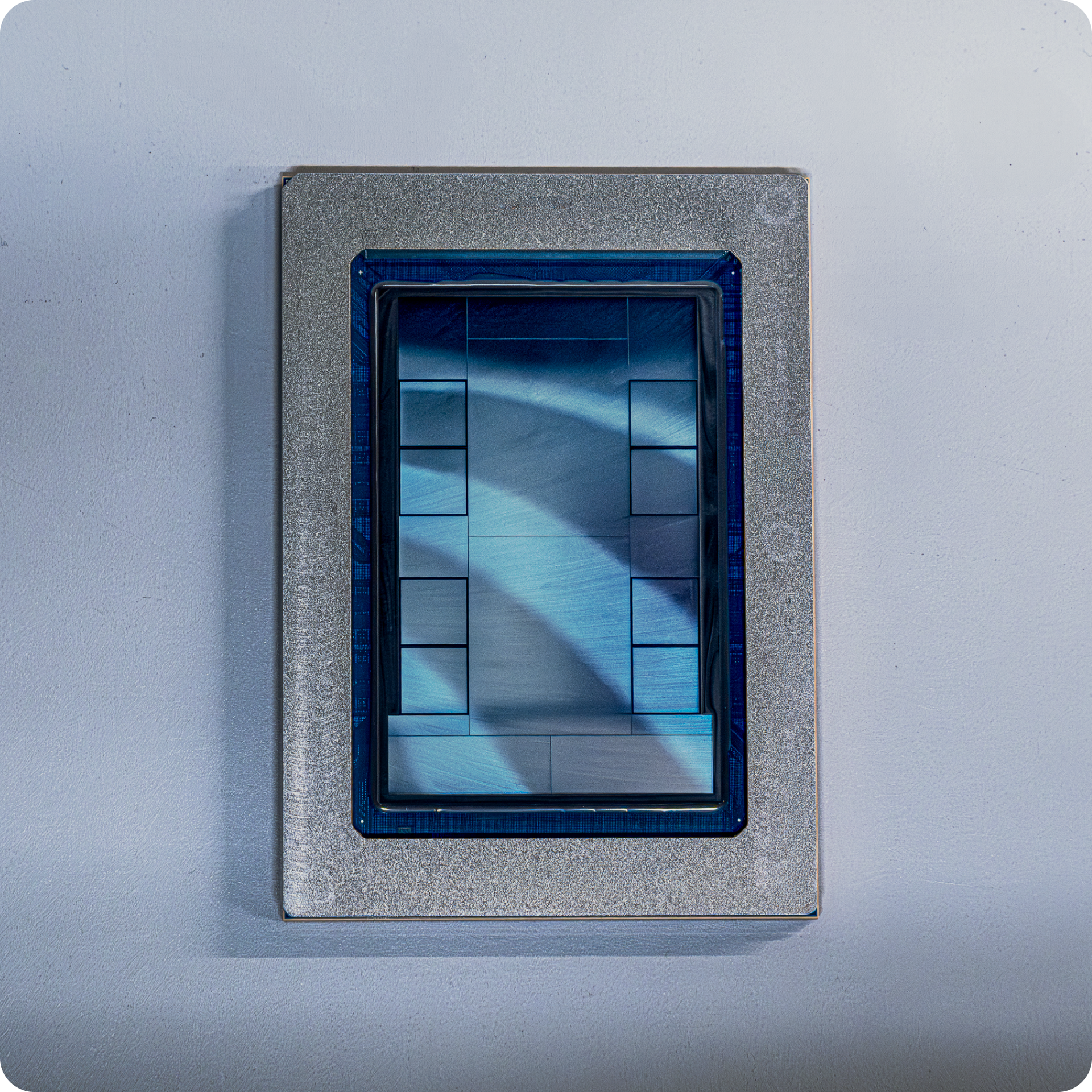

Desarrollados en colaboración con Broadcom, los nuevos aceleradores MTIA presentan una notable evolución respecto a sus predecesores. Desde el MTIA 300 hasta el MTIA 500, Meta ha incrementado el ancho de banda de la memoria HBM (High Bandwidth Memory) en 4.5 veces y ha multiplicado la capacidad de cálculo por 25 en menos de dos años. Estos adelantos se convierten en ventajas estratégicas en la inferencia generativa, un campo donde el cuello de botella ya no se localiza singularmente en las mismas etapas que el entrenamiento.

La industria está adoptando un enfoque más modular y eficiente en la iteración de hardware, con Meta destacando su capacidad para introducir nuevas generaciones de chips cada seis meses. Esto es posible gracias a una arquitectura de chiplets y la reutilización de la infraestructura existente, optimizando tanto el despliegue como los costos. Además, la interoperabilidad via software abierto, con plataformas como PyTorch y Triton, fortalece la posición de Meta en el entorno de silicio personalizable.

Otras compañías como Google, AWS y Microsoft también han encaminado esfuerzos similares. Google ha lanzado su TPU Ironwood diseñada para la era de inferencia, AWS promueve Trainium3 e Inferentia, mientras que Microsoft apuesta por Maia 200. Todas estas soluciones confirman una estrategia compartida: la adopción de silicio propio para cargas predecibles de alta demanda.

En el trasfondo de esta evolución tecnológica, Broadcom se perfila como un sólido colaborador en el desarrollo de silicio personalizado para IA, colaborando no solo con Meta, sino también con otras grandes empresas como OpenAI. Estos acuerdos destacan la importancia del diseño de chips a medida, que escalan y satisfacen las exigencias de capital masivo y despliegue.

La aceleración en el diseño de hardware por parte de los hiperescalares no deja de lado a Nvidia, pero señala una era en la que la eficiencia y la especialización en la inferencia de IA dictarán cada vez más las decisiones de arquitectura. Con Meta a la vanguardia de este cambio, el futuro inmediato del consumo de IA podría redefinir el equilibrio en la industria, privilegiando soluciones que equilibren costos y rendimiento en cada caso de uso particular.