En el ámbito de la inteligencia artificial moderna, el fenómeno de las «alucinaciones» ha surgido como un desafío significativo en los modelos de lenguaje grande (LLM, por sus siglas en inglés). Estos modelos, aunque logran generar respuestas fluidas y contextualmente relevantes, a menudo producen información errónea o completamente inventada. Esta tendencia plantea serios riesgos en sectores críticos como la salud, las finanzas y el ámbito legal, donde la precisión de los datos es esencial.

La comunidad tecnológica ha respondido con diversas estrategias para mitigar este problema. Una de las soluciones más prometedoras es la Generación de Recuperación Aumentada (RAG, por sus siglas en inglés), que infunde a los modelos de lenguaje la capacidad de buscar y utilizar información de fuentes externas verificadas. Esto no solo reduce las probabilidades de que el modelo produzca respuestas incorrectas, sino que también mejora la fiabilidad del contenido generado.

Amazon ha desarrollado una respuesta innovadora a este problema a través de sus Guardas de Bedrock. Este sistema emplea verificaciones contextuales para identificar alucinaciones, y puede integrarse en los procesos de trabajo mediante APIs de Amazon Bedrock o flujos de prompts personalizados. Sin embargo, un reto continuo es la naturaleza estática de estos flujos, que limita su adaptabilidad frente a los cambios en el contexto informativo.

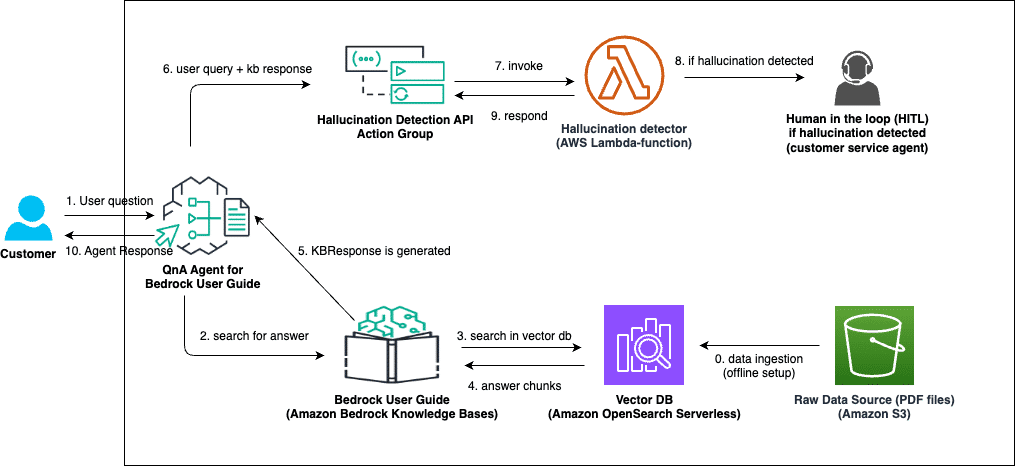

Para solucionar la rigidez de los sistemas estáticos, Amazon ha introducido sus Bedrock Agents, que permiten la orquestación dinámica de flujos de trabajo. Esta herramienta otorga a las organizaciones la capacidad de detectar y mitigar alucinaciones de manera escalable y personalizada, sin la necesidad de reformar completamente sus procesos existentes. Por ejemplo, en caso de una alucinación detectada, un flujo de trabajo con agentes de Amazon puede redirigir la consulta a un agente de servicio al cliente para garantizar una respuesta precisa y satisfactoria al usuario.

Mediante la implementación combinada de enfoques como RAG y la flexibilidad de los agentes de Amazon, las empresas pueden crear soluciones de inteligencia artificial generativa más exactas y adaptadas a sus necesidades. Esto no solo optimiza los flujos de trabajo con la eficiencia de la automatización AI, sino que también reduce costes y mejora la productividad, estableciendo un nuevo estándar de seguridad y fiabilidad en aplicaciones críticas donde la veracidad es imperativa. Así, el desarrollo continuo en inteligencia artificial asegura un futuro donde la tecnología no solo es más inteligente, sino también más confiable y segura para su integración en las actividades humanas esenciales.