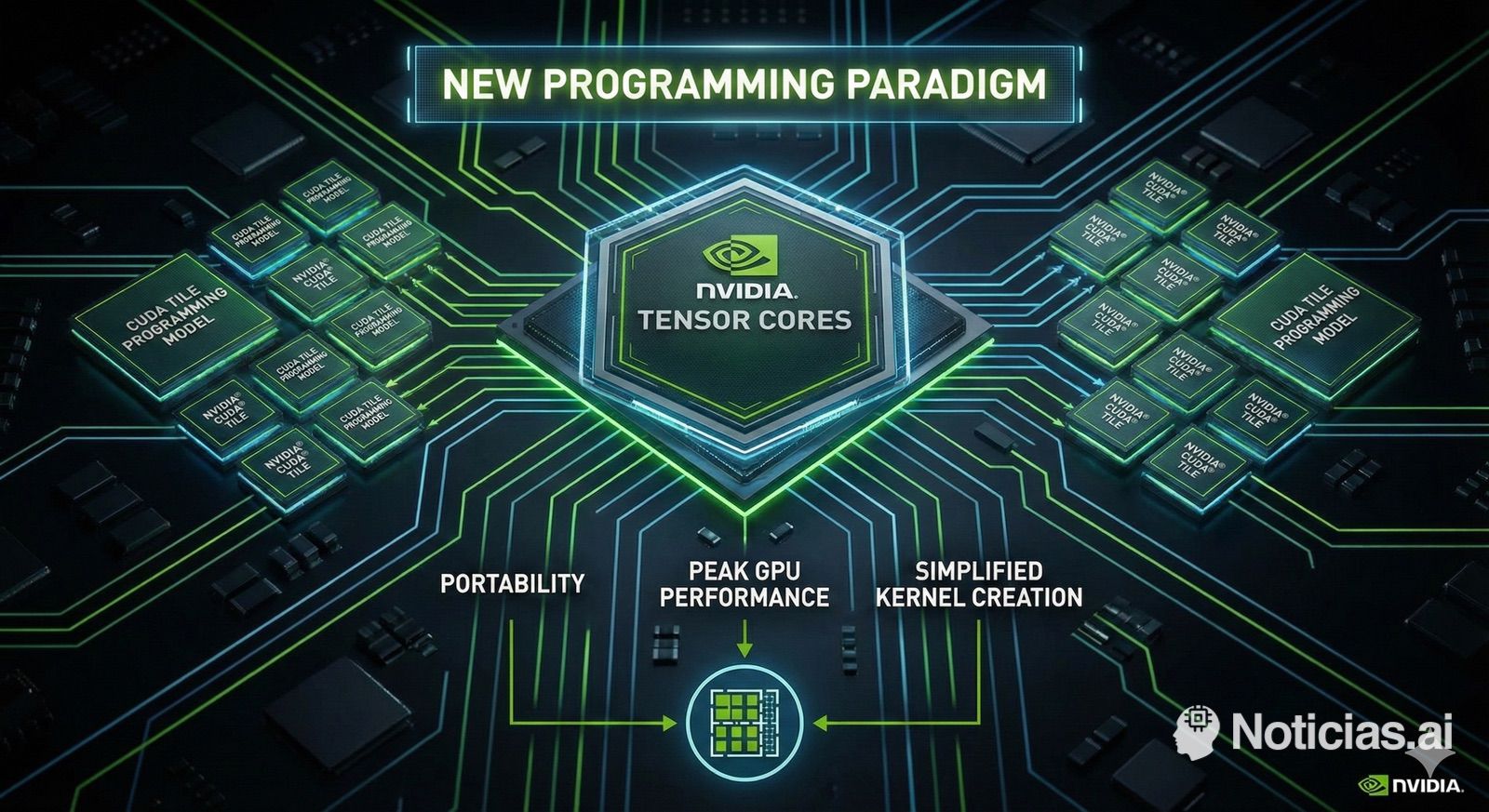

NVIDIA ha dado un paso estratégico en el terreno del software con la presentación de CUDA 13.1 y la introducción de CUDA Tile, una evolución significativa en su modelo de programación GPU, estableciendo el mayor cambio conceptual desde 2006. Esta iniciativa tiene como objetivo que los desarrolladores se centren más en los algoritmos que en el hardware, promoviendo la programación de “tiles” en lugar de hilos individuales.

El cambio de hilos y warps a tiles supone un nuevo paradigma de programación. CUDA requería anteriormente una gestión detallada de la distribución de hilos y bloques, la jerarquía de memorias y las sincronizaciones, lo cual generaba un código estrechamente ligado a la microarquitectura y una curva de aprendizaje considerable. CUDA Tile elimina este enfoque, permitiendo a los desarrolladores trabajar con fragmentos lógicos de datos, dejando que el compilador y el runtime traduzcan el trabajo a instrucciones concretas.

CUDA Tile se presenta como un modelo orientado a los Tensor Cores y diseñado para ser portátil entre generaciones de GPU, empleando Tile IR como intermediario entre el código del desarrollador y el hardware. CuTile, su primera implementación, está disponible en Python, con perspectivas de expandirse a C++. Esto permite que los ingenieros escriban kernels de alto rendimiento usando una sintaxis familiar, centrando las operaciones en tiles.

Las nuevas arquitecturas Blackwell y Blackwell Ultra son el primer banco de pruebas de este modelo, optimizadas para trabajar con tiles. Estas incorporan Tensor Cores y vías de datos adecuadas para una gestión inteligente de memoria, minimizando las latencias y optimizando el uso de unidades especializadas. Bajo esta filosofía, la responsabilidad de optimización se transfiere del programador al compilador, dando estabilidad al código fuente aún con la introducción de nuevas generaciones de GPU.

Para los equipos de inteligencia artificial y computación científica, las ventajas son evidentes. CUDA Tile promete reducir el volumen de código específico de hardware, acelerar el desarrollo de prototipos y garantizar la portabilidad entre generaciones de GPU, manteniendo un rendimiento más uniforme y eficiente.

Este movimiento refuerza el ecosistema de software de NVIDIA, integrando hardware, compilador, bibliotecas y herramientas de desarrollo de manera que otros actores aún no alcanzan. Esto incrementa la esperanza de que el código CUDA continúe funcionando y mejorando con el tiempo, apoyado por herramientas maduras y una comunidad extensa.

Sin embargo, persisten algunos desafíos. Los equipos deberán decidir cómo y cuándo adoptar CUDA Tile, encontrar el equilibrio adecuado entre control y abstracción, y afrontar el riesgo de dependencia tecnológica. A pesar de estas cuestiones, NVIDIA ha sentado las bases para la próxima década de programación GPU, combinando hardware sofisticado con un software en constante evolución.