En un panorama donde la inteligencia artificial (IA) está transformando industrias, la capacidad de adaptar modelos de lenguaje a sectores específicos se torna crucial. Los modelos de lenguaje de gran tamaño (LLMs) han demostrado gran habilidad en tareas de propósito general, sin embargo, enfrentan retos al manejar dominios con terminología altamente especializada. Esta limitación es evidente en campos como la industria automotriz, donde los diagnósticos suelen apoyarse en códigos específicos que cada fabricante utiliza.

Los códigos de diagnóstico automático (DTCs) como P0300, referente a un fallo genérico en el motor, o C1201, relacionado con el sistema ABS, son fundamentales para un diagnóstico preciso. Sin ellos, un modelo de lenguaje general puede tropezar, produciendo respuestas erróneas al inventar posibles causas o situaciones, especialmente cuando se le suministra información vaga como “motor funcionando de manera irregular”.

Para contrarrestar esta brecha, la personalización de modelos de lenguaje de pequeño tamaño (SLMs) toma protagonismo. Estos modelos, compactos y eficientes, no solo posibilitan una mejor adaptación a dominios específicos, sino que también optimizan tiempos de inferencia y recursos requeridos, resultando en mayor costo-efectividad. Con parámetros que oscilan entre 1 a 8 mil millones, los SLMs sobresalen en tareas especializadas, y están optimizados para funcionar en dispositivos de computación en el borde.

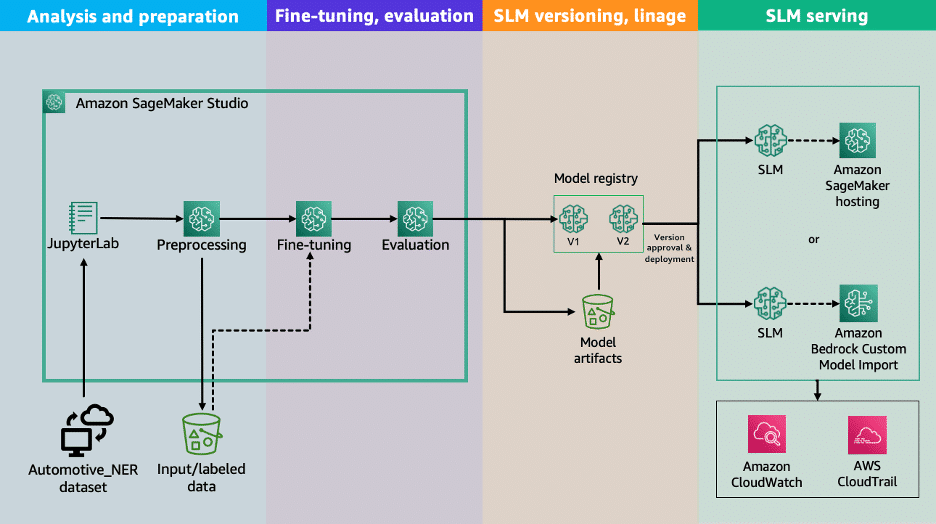

Técnicas avanzadas como la Adaptación de Bajo Rango (LoRA) han democratizado el acceso a la personalización de modelos, ampliando las posibilidades para clientes diversos. En Amazon Web Services (AWS), existen herramientas como Amazon Bedrock, que facilita la construcción y personalización de aplicaciones de IA generativa, y Amazon SageMaker, que permite manejar el ciclo de vida completo de modelos de machine learning, desde su entrenamiento hasta su despliegue.

Un reciente esfuerzo en esta dirección ha sido documentado en un proyecto de personalización de SLMs en AWS, enfocado en la terminología automotriz para mejorar tareas de preguntas y respuestas sobre diagnósticos de vehículos. El proceso abarcó desde el análisis de datos hasta la evaluación de modelos personalizados, resaltando diferencias tanto en precisión como en la riqueza del vocabulario entre un SLM adaptado y su contraparte de propósito general.

Estos avances no solo ofrecen soluciones más precisas para el sector automotriz, sino que también sientan las bases para llevar estos métodos a otras áreas especializadas, permitiendo a las industrias aprovechar mejor las capacidades de la IA. Los interesados pueden acceder al código fuente y las guías detalladas en el repositorio en Github vinculado al proyecto.