Amazon Bedrock ha dado un paso significativo al lanzar su nueva funcionalidad denominada Knowledge Bases, diseñada para revolucionar la implementación de flujos de trabajo de Generación Aumentada por Recuperación (RAG). Este sistema, completamente gestionado, abarca un proceso uniforme desde la ingestión hasta la recuperación y augmentación de prompts, eliminando la necesidad de construir integraciones personalizadas con diversas fuentes de datos.

La optimización del rendimiento en estas bases de conocimiento es un proceso único para cada caso de uso. Los parámetros de configuración afectan de distintas maneras cada aplicación, por lo cual es imperativo realizar pruebas constantes y ajustar configuraciones para identificar la mejor opción para cada situación particular.

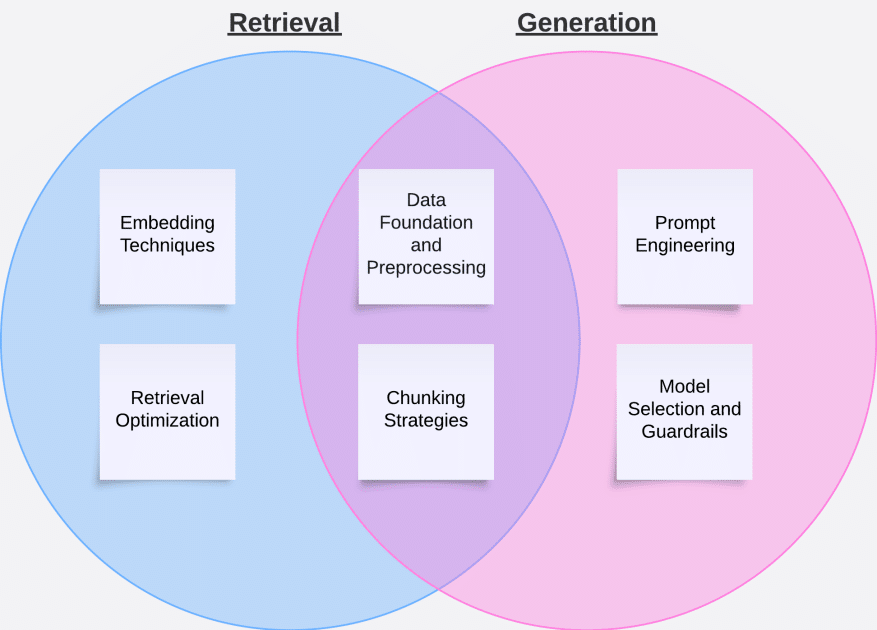

Según un reciente artículo, existen varias etapas críticas para evaluar el rendimiento de una base de conocimiento. Estos pasos incluyen, por un lado, la evaluación del proceso de recuperación, y por otro, la generación de respuestas. Durante la recuperación, se obtienen fragmentos relevantes de documentos con base en una consulta, agregando estos elementos al contexto del prompt final. La generación, en cambio, consiste en enviar el prompt del usuario junto al contexto recuperado a un modelo de lenguaje grande (LLM), devolviendo finalmente la salida al usuario.

Para medir la eficacia de la recuperación, Amazon Bedrock utiliza dos métricas clave: la relevancia del contexto, que verifica si la información aborda adecuadamente la intención de consulta; y la cobertura del contexto, que evalúa la exhaustividad de los textos recuperados contra la verdad objetiva. Estas métricas se establecen al comparar los resultados de búsqueda con las respuestas esperadas dentro de un conjunto de datos de prueba que cumple con formatos específicos.

Una vez validado que el flujo de trabajo de RAG recupera eficientemente el contexto relevante, se procede a la evaluación de la fase de generación. El marco de evaluación ofrecido por Amazon Bedrock es integral y considera ocho métricas, abarcando tanto la calidad de la respuesta como criterios de inteligencia artificial responsable. Entre las métricas de calidad se consideran aspectos como la utilidad, la corrección, la coherencia lógica, la completitud y la fidelidad. Adicionalmente, las métricas de inteligencia artificial responsable evalúan la presencia de contenido dañino o estereotipado y la capacidad del sistema para negar adecuadamente responder a preguntas inapropiadas.

Para asegurar una evaluación significativa, es esencial construir un conjunto de datos de prueba robusto, recomendando el uso de datos anotados por humanos, generación de datos sintéticos con LLMs y una estrategia de mejora continua basada en la retroalimentación de los usuarios. El enfoque iterativo es crucial, permitiendo ajustes precisos y significativos en las técnicas de mejora de rendimiento.

La optimización de las Bases de Conocimiento de Amazon Bedrock es, de este modo, un proceso iterativo que requiere pruebas y refinamientos sistemáticos. El éxito, sostienen los expertos, se alcanza mediante el uso metódico de técnicas como la ingeniería de prompts y el chunking para optimizar tanto la etapa de recuperación como la de generación. Monitorear las métricas clave a lo largo de este camino garantizará que se cumplan los requisitos de la aplicación y se maximice el impacto de las optimizaciones implementadas.