La computación de alto rendimiento se ha convertido en un componente crucial para el avance de la inteligencia artificial, permitiendo la creación de modelos cada vez más complejos y eficientes. En este contexto, la reciente disponibilidad de la plataforma NVIDIA Blackwell GB200 NVL72 en la nube, a través de CoreWeave, marca un hito importante en la industria. CoreWeave se ha convertido en el primer proveedor de servicios en ofrecer estas instancias, mostrando así su compromiso con la innovación tecnológica.

Esta infraestructura masiva está diseñada para operar hasta con 110,000 GPUs, posibilitando un rendimiento óptimo para modelos de razonamiento de inteligencia artificial y agentes autónomos. La capacidad de generar respuestas en tiempo real cobra un significado especial en aplicaciones que requieren una eficiencia logística sin precedentes.

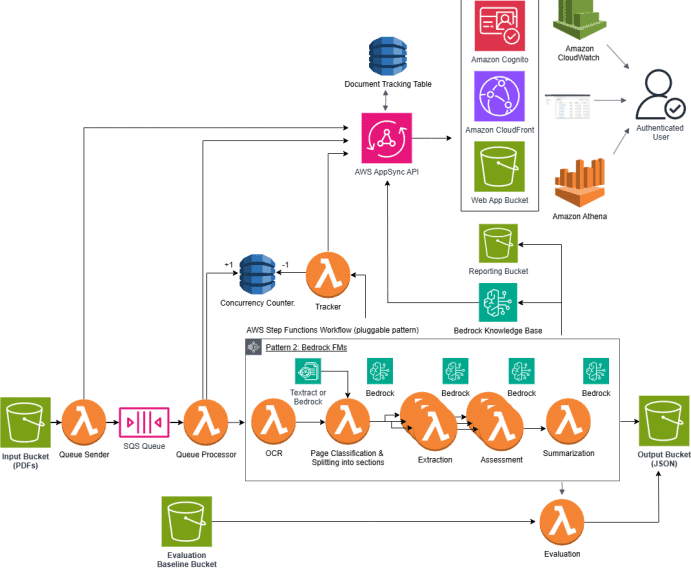

El sistema NVIDIA GB200 NVL72, compuesto por 72 GPUs Blackwell interconectadas mediante NVLink, ofrece un ecosistema de computación única. Este diseño es fundamental para el manejo de modelos de inteligencia artificial avanzada que requieren alta velocidad de comunicación interna, una memoria optimizada y una gran capacidad de procesamiento.

Entre sus características más destacadas se encuentran un ancho de banda de 130TB/s gracias a la tecnología NVLink de quinta generación, la cual mejora la eficiencia en la comunicación entre las GPUs. Además, cuenta con un motor Transformer de segunda generación que soporta FP4, mejorando la velocidad de generación de tokens mientras mantiene la precisión. La infraestructura también incluye Networking NVIDIA Quantum-2 InfiniBand con un ancho de banda de 400 Gb/s por GPU, lo que facilita la escalabilidad deseada. Las BlueField-3 DPUs, por su parte, optimizan el acceso a los datos y contribuyen a mejorar la elasticidad en entornos de múltiples usuarios.

Esta avanzada plataforma se posiciona como una opción ideal para empresas que buscan implementar modelos de inteligencia artificial generativa con el mayor rendimiento y eficiencia posibles. El uso de instancias GB200 NVL72 en CoreWeave está especialmente diseñado para facilitar implementaciones en sectores como la salud, la investigación científica y la automatización empresarial. Junto a esta infraestructura, NVIDIA ofrece una pila de software optimizada para inteligencia artificial que incluye NVIDIA Blueprints, NVIDIA NIM y NVIDIA NeMo, brindando a las empresas herramientas para desarrollar modelos de IA con precisión, velocidad y escalabilidad.

Las instancias GB200 NVL72 están disponibles en la región US-WEST-01 del CoreWeave Kubernetes Service bajo el identificador de instancia gb200-4x. Esta disponibilidad representa un significativo avance en la evolución de la inteligencia artificial, permitiendo a los modelos operar a gran escala con tiempos de respuesta optimizados y reduciendo los costos del servicio. De esta manera, NVIDIA y CoreWeave están dando inicio a una nueva era en la computación de alto rendimiento, ofreciendo soluciones adaptadas a las necesidades de la próxima generación de inteligencia artificial.