La presencia del contenido de video se ha expandido significativamente, abarcando desde la vigilancia de seguridad hasta la producción de medios, plataformas sociales y comunicaciones empresariales. Sin embargo, extraer información significativa de grandes volúmenes de video sigue siendo un desafío importante para muchas organizaciones. La comprensión del contenido no solo involucra lo que se visualiza, sino también el contexto, la narrativa y el significado subyacente.

En un desarrollo reciente, Amazon ha lanzado una innovación en el análisis de video con sus modelos de fundación multimodal, disponibles a través de Amazon Bedrock. Estos modelos facilitan una comprensión escalable del video a través de tres enfoques arquitectónicos distintos. Cada enfoque está diseñado para diferentes casos de uso, con un ojo puesto en el rendimiento y los costos. Esta solución se encuentra disponible como un recurso de código abierto en GitHub.

La evolución del análisis de video ha sido notable. Los métodos tradicionales, dependientes de revisiones manuales o técnicas básicas de visión por computadora, se enfrentan a limitaciones significativas en términos de escalabilidad, flexibilidad y comprensión semántica. La llegada de los modelos multimodales permite un procesamiento más complejo, que incluye tanto información visual como textual, mejorando así la capacidad para interpretar escenas, generar descripciones en lenguaje natural y detectar eventos sutiles difíciles de definir programáticamente.

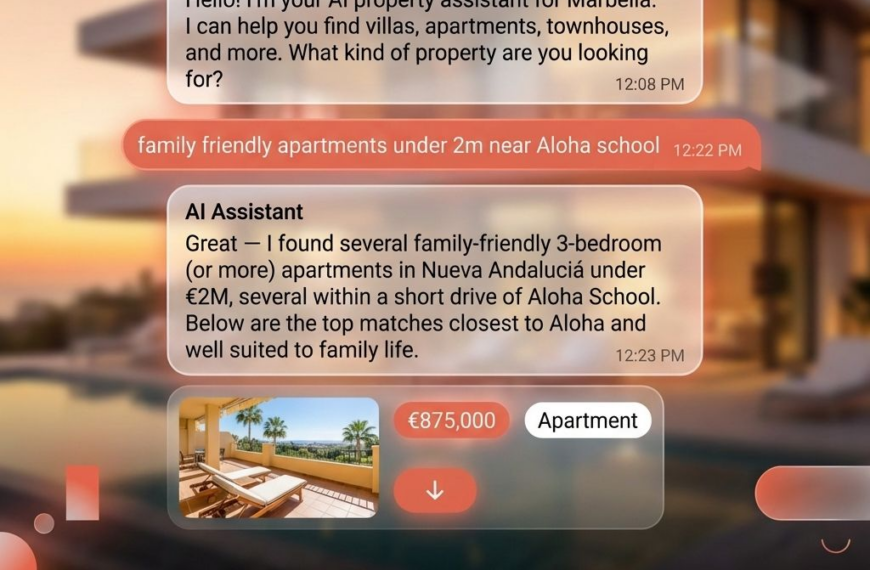

Entender el contenido de video implica la integración de información visual, auditiva y temporal para obtener ideas significativas. Existen distintas aplicaciones, como el análisis de escenas mediáticas, la detección de interrupciones publicitarias y la moderación de contenido en redes sociales, que requieren flujos de trabajo adaptados a sus características específicas. En este contexto, se proponen tres flujos de trabajo: el basado en fotogramas, el basado en tomas y el de incrustaciones multimodales.

El flujo de trabajo basado en fotogramas permite muestrear imágenes a intervalos fijos y aplicar modelos de comprensión de imágenes para extraer información visual. Este método es ideal para la seguridad y vigilancia, aseguramiento de calidad y monitoreo de cumplimiento. Por otro lado, el flujo basado en tomas segmenta el video en clips cortos, capturando mejor el contexto temporal, y es útil para la producción mediática y la catalogación de contenido.

La opción más reciente, la incrustación multimodal, es especialmente prometedora para las aplicaciones de búsqueda semántica de video, permitiendo búsquedas en lenguaje natural y búsqueda por similitud visual. A medida que se implementan estas soluciones, las organizaciones pueden gestionar costos y rendimiento de manera más efectiva, optimizando su análisis de video.

El conjunto completo de la solución está construido sobre servicios sin servidor de AWS, ofreciendo escalabilidad y eficiencia en términos de costos. La arquitectura incluye distintos servicios para la extracción, el backend para los modelos de incrustación y también una interfaz web para facilitar la interacción con el usuario.

Con el creciente uso del video en diferentes sectores, esta nueva herramienta abre un camino accesible para cualquier organización interesada en implementar análisis de video avanzado sin necesidad de contar con equipos de visión por computadora especializados. La capacidad de elegir el enfoque adecuado para cada caso de uso es fundamental, ya sea para monitoreos precisos, contenidos narrativos o búsquedas semánticas. La evolución continua de los modelos multimodales anticipa mejoras aún más sofisticadas en la comprensión del video, transformando la forma en que interpretamos y interactuamos con este medio.