La competencia tecnológica entre los procesadores centrales (CPU) y las unidades de procesamiento gráfico (GPU) en el ámbito de la inteligencia artificial ha dado un inesperado giro. Intel ha presentado un avance que podría redefinir el panorama, demostrando que sus procesadores, gracias a un rediseño de microkernels optimizados, pueden rivalizar con el rendimiento de las GPUs de NVIDIA, específicamente el modelo A100, en la ejecución de grandes modelos de lenguaje.

El secreto no reside en un nuevo chip, sino en las multiplicaciones de matrices dentro de la CPU. Aprovechando al máximo las instrucciones AVX2 y empleando nuevas disposiciones de datos, Intel ha logrado que modelos cuantizados en 1 y 2 bits alcancen réditos hasta siete veces superiores frente a la inferencia tradicional de 16 bits.

Esta innovación marca un giro en el estándar hasta hoy establecido, donde el uso de pesos de 16 bits era la norma. Intel ha ido más allá, desarrollando microkernels que pueden «empaquetar» información de forma extremadamente compacta, lo cual permite un drástico ahorro de ancho de banda y memoria. Las pruebas realizadas indicaron que, pese a esta optimización, el rendimiento final del modelo mantiene una calidad elevada.

En pruebas concretas, mientras una GPU NVIDIA A100 logra 250 tokens por segundo, los procesadores Intel Core Ultra alcanzaron entre 82 y 110 tokens por segundo. Sorprendentemente cerca, considerando que la GPU tiene entre 17 a 20 veces más ancho de banda de memoria gracias a su HBM2E en comparación con la DDR5 que utilizan las CPUs.

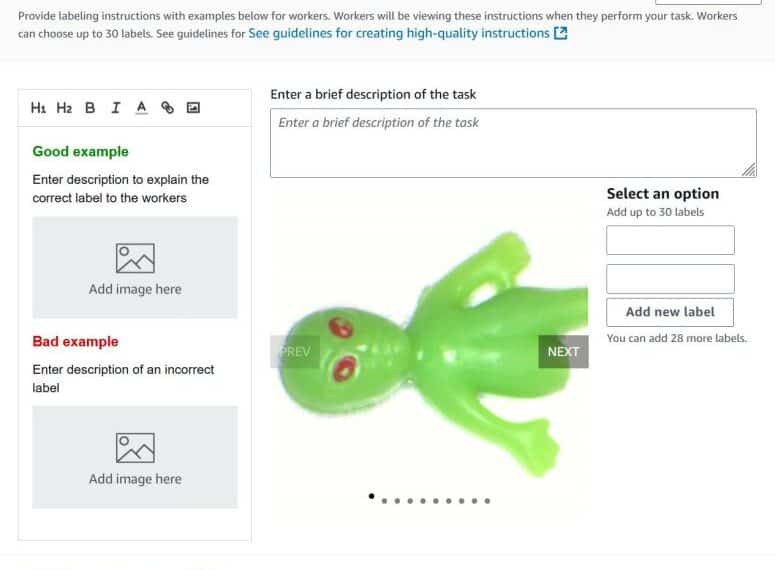

Intel evaluó el rendimiento utilizando modelos como Llama3-8B, Falcon3-1B y MobileLLM-1.5B, mostrando consistencia en los resultados. La tecnología avanza mediante un método denominado “up-convert and compute”, donde los pesos se almacenan en 1 o 2 bits y se convierten en enteros de 8 bits para su procesamiento, optimizando el rendimiento con instrucciones AVX2.

Este avance podría tener un impacto significativo al democratizar el acceso a IA avanzadas, permitiendo su ejecución en dispositivos convencionales como portátiles, sin necesidad de una GPU dedicada. Además, el ahorro energético y el potencial para su uso en dispositivos de baja potencia abre nuevos escenarios para la IA, desde ordenadores personales hasta sistemas embebidos.

Mientras NVIDIA ha liderado la IA con sus GPUs, la propuesta de Intel podría significar un cambio estratégico. La capacidad de ejecutar inferencia en CPUs comunes podría reducir la necesidad de GPUs especializadas para muchos usuarios. Aunque las CPUs aún no igualan completamente la paralelización masiva de las GPUs de alto rendimiento, Intel se aproxima en rendimiento para ciertos casos prácticos.

A futuro, Intel busca portar estas innovaciones a arquitecturas ARM, sugiriendo que teléfonos y tablets podrían beneficiarse de estos avances. Con la llegada de AVX10.2, se espera una optimización mayor aún, expandiendo las capacidades de las CPUs frente a las GPUs.

Este desarrollo plantea un nuevo horizonte en la inteligencia artificial, acercándonos a una era donde modelos de IA de gran escala sean accesibles desde cualquier dispositivo, eliminando barreras y cimentando el camino hacia una IA más universal y democratizada.