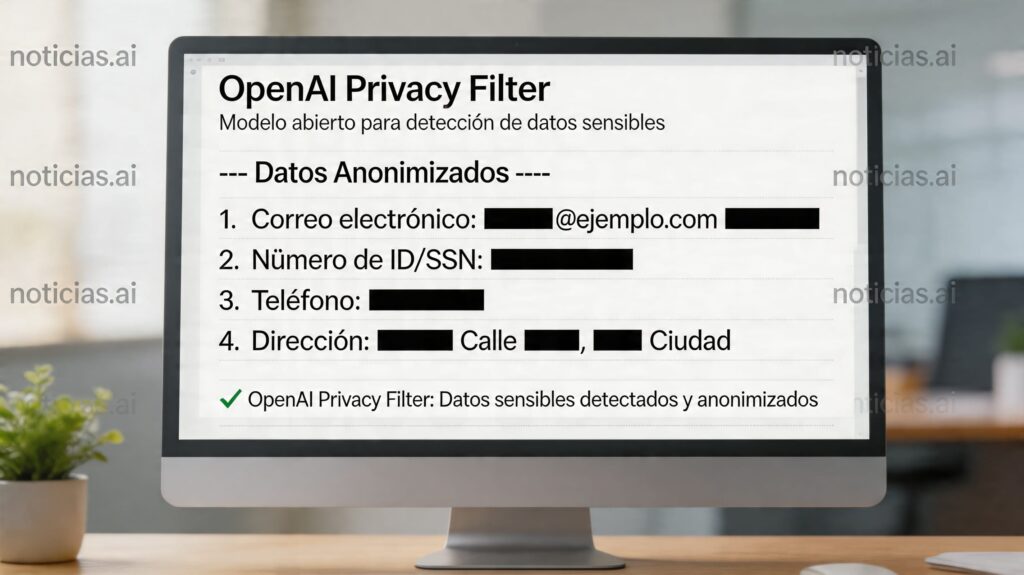

OpenAI ha lanzado Privacy Filter, un innovador modelo diseñado para detectar y enmascarar información personal identificable (PII, por sus siglas en inglés) en textos, brindando una solución que permite a las empresas procesar datos sensibles localmente, sin enviar información a servicios externos. Disponible bajo la licencia Apache 2.0, Privacy Filter está orientado a mejorar los flujos de saneamiento de datos, un desafío clave en un mundo donde el manejo seguro de grandes volúmenes de información es esencial para el desarrollo de sistemas de inteligencia artificial.

Este modelo ha sido presentado en un momento crucial, pues muchas organizaciones están implementando asistentes internos y sistemas de almacenamiento y búsqueda que requieren procesar enormes cantidades de texto. La falta de filtrado de datos puede conllevar a la exposición indebida de información como nombres, correos electrónicos, números de teléfono o cuentas bancarias, aumentando los riesgos de seguridad y privacidad. Privacy Filter actúa como una barrera preventiva, asegurando que estos datos no se indexen ni se utilicen inapropiadamente.

A diferencia de los modelos generativos tradicionales, Privacy Filter es un sistema de clasificación de tokens con decodificación de spans, lo que le permite escanear y etiquetar rápidamente fragmentos de texto que deben ser enmascarados. Con un diseño eficiente, sostiene 1.500 millones de parámetros totales y 50 millones de parámetros activos, permitiendo su ejecución incluso en dispositivos modestos como navegadores web o portátiles. Gracias a su ventana de contexto de 128.000 tokens, puede procesar documentos extensos sin necesidad de dividirlos, lo que representa una ventaja significativa en entornos donde la latencia y el coste son tan críticos como la protección de la privacidad.

Una de las fuerzas del Privacy Filter es su capacidad para manejar texto desestructurado y tomar decisiones basadas en el contexto, superando a las herramientas tradicionales que dependen de patrones rígidos. Opera sobre ocho categorías de datos sensibles, desde números de cuenta hasta claves API, y utiliza un esquema de salida BIOES para marcar con precisión los fragmentos sensibles, una característica invaluable al prevenir la indexación de información crítica en sistemas avanzados como los modelos de recuperación y generación (RAG).

OpenAI asegura que Privacy Filter alcanza un notable 96% de F1 en benchmarks diseñados para mascar PII, con precisiones que mejoran ante ajustes específicos. Sin embargo, la empresa enfatiza que, aunque sus cifras son prometedoras, es prudente considerar que los resultados pueden variar según el dataset utilizado, el idioma y el contexto operativo en el que se despliega.

Es importante destacar que Privacy Filter no está pensado como una solución de anonimización total ni una garantía legal de cumplimiento normativo. En su lugar, OpenAI lo posiciona como parte de una estrategia más amplia de privacidad por diseño. Esto se debe a que, en muchos casos, no basta con enmascarar datos evidentes; las combinaciones de datos pueden conducir a una reidentificación indebida.

A pesar de su evaluación multilingüe, Privacy Filter no está optimizado específicamente para el español, lo cual puede influir en su rendimiento en contextos no ingleses. Sin embargo, el modelo marca una tendencia hacia desarrollar herramientas eficientes, auditables y fáciles de implementar en local para abordar retos específicos de privacidad, una necesidad creciente en la era de la información digital desenfrenada. Privacy Filter se presenta como una opción lógica dentro del ecosistema tecnológico actual, aportando una capa adicional de seguridad y privacidad a la hora de manejar datos sensibles.