En el ámbito de la inteligencia artificial, los modelos de lenguaje grande (LLMs) han surgido como herramientas multifacéticas, capaces de abordar una amplia gama de tareas de procesamiento del lenguaje natural (NLP), que van desde el manejo de conversaciones simples hasta la ejecución de tareas complejas como la toma de decisiones o la creación de resúmenes. Sin embargo, a medida que estos modelos son cada vez más integrados en aplicaciones diversas, las limitaciones de los métodos tradicionales de ingeniería de prompts y el ajuste fino supervisado se hacen evidentes. Estos enfoques a menudo fallan al alinear de manera eficaz los modelos con las verdaderas intenciones del usuario, generando en ocasiones respuestas erróneas, sesgadas, tóxicas o de escaso valor.

La utilización del aprendizaje supervisado en el entrenamiento de LLMs puede mejorar su rendimiento hasta cierto punto, pero no aborda las complejidades éticas y sociales que son difíciles de capturar en ejemplos simples. En muchas ocasiones, el resultado es un comportamiento del modelo que contradice el objetivo deseado, dejando una brecha significativa por llenar.

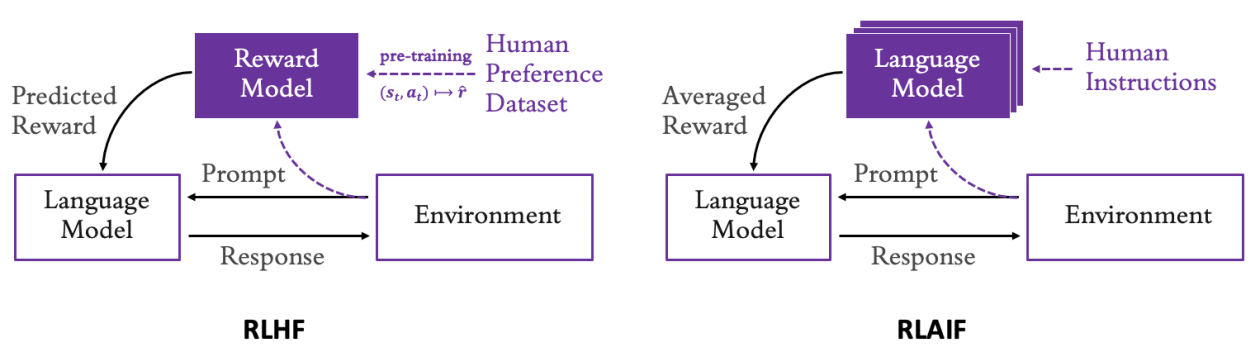

Frente a estos desafíos, una alternativa prometedora ha surgido: el entrenamiento por refuerzo con retroalimentación humana (RLHF, por sus siglas en inglés). Este método utiliza la evaluación humana para afinar los comportamientos de los LLMs conforme a las preferencias y valores humanos. Más recientemente, un enfoque aún más vanguardista ha comenzado a ganar atención: la superalineación utilizando retroalimentación de IA (RLAIF). A través de este método, se emplean múltiples LLMs especializados en distintos aspectos de las preferencias humanas, como la relevancia, la concisión o la reducción de la toxicidad. Esto permite prescindir de servicios de anotación humana, haciendo el proceso de ajuste más eficiente.

La implementación de técnicas como RLAIF ha demostrado ser prometedora en la creación de sistemas de IA que no solo son útiles, sino también éticos y no dañinos. Estos sistemas mantienen su funcionalidad incluso en casos donde algunas capacidades de IA igualan o superan el rendimiento humano.

Un caso de uso específico de RLAIF podría involucrar la generación de diálogos con menor incidencia de respuestas tóxicas. Para ello, podrían emplearse modelos de recompensa ya disponibles y así ajustar finamente los LLMs, evaluando sus mejoras con pruebas en conjuntos de datos dedicados.

El desarrollo y perfeccionamiento de LLMs es un campo en constante evolución, y técnicas como RLAIF abren nuevas posibilidades para afinar la coherencia de la IA con los valores humanos, asegurando respuestas más precisas y menos perjudiciales. La investigación continua en este ámbito es crucial para enfrentar los retos éticos y técnicos que plantea la inteligencia artificial moderna.