En el dinámico campo del entrenamiento de modelos de inteligencia artificial a gran escala, los desafíos relacionados con la recuperación tras fallos y la monitorización cobran gran relevancia. Las soluciones tradicionales suelen reiniciar todo el proceso de entrenamiento ante un fallo, incrementando los tiempos de inactividad y los costos. La expansión de los clústeres de entrenamiento añade complejidad, ya que enfrentan problemas como GPUs atascadas e inestabilidades numéricas, lo que requiere un monitoreo complejo.

En respuesta, Amazon SageMaker presenta HyperPod, una innovadora herramienta que acelera el desarrollo de modelos de IA, logrando reducir el tiempo de entrenamiento hasta en un 40%. Este operador de entrenamiento está diseñado para mejorar la resiliencia de las cargas de trabajo en Kubernetes a través de recuperaciones precisas y un monitoreo personalizable.

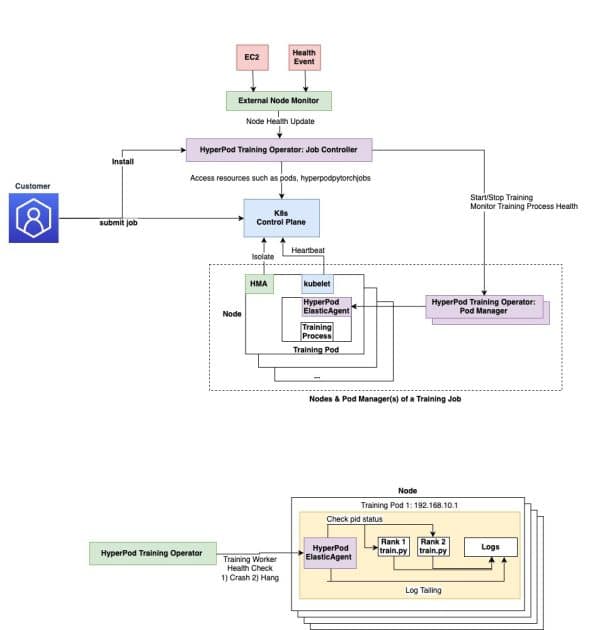

HyperPod se integra como complemento de Amazon Elastic Kubernetes Service (EKS), permitiendo una gestión eficiente del entrenamiento distribuido en clústeres de GPU. Utiliza definiciones de recursos personalizadas (CRD) y sigue el patrón de operador de Kubernetes. Esta estructura incorpora componentes como el controlador de trabajos y el gestor de pods.

Una de las ventajas más destacadas es su capacidad de recuperación granular. En lugar de reiniciar trabajos completos, el operador reanuda solo los procesos afectados, disminuyendo el tiempo de recuperación de minutos a segundos y mejorando la eficiencia operativa. Además, incluye un sistema que identifica nodos problemáticos y facilita la recuperación de trabajos afectados por fallos de hardware, eliminando la necesidad de intervenciones manuales.

HyperPod también ofrece monitoreo centralizado y asignación eficiente de recursos, facilitando la detección de fallos y problemas de rendimiento. Esto se hace a través de configuraciones YAML simples, lo que permite un seguimiento más efectivo de los procesos.

Para implementar este operador, se dispone de una guía detallada que explica cómo desplegar y gestionar cargas de trabajo con HyperPod. La instalación, que toma entre 30 y 45 minutos, exige la verificación de recursos y permisos necesarios en AWS. Incluye instrucciones sobre la instalación de componentes adicionales y la gestión de trabajos con PyTorch mediante Kubernetes.

Al concluir un ciclo de entrenamiento, es crucial limpiar los recursos usados para evitar costos adicionales, eliminando trabajos, imágenes de contenedores y complementos instalados.

Este enfoque promete transformar cómo las organizaciones enfrentan los desafíos del entrenamiento de modelos de inteligencia artificial, brindando una solución sólida y eficiente para la escala masiva. Con HyperPod, las empresas pueden optimizar sus procesos, reduciendo costos y aumentando la eficiencia en sus proyectos de inteligencia artificial.